Meine Themengebiete

- Details

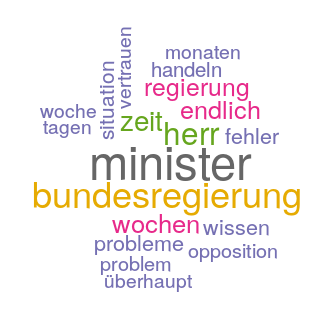

- Thema: Datenjournalismus

Ich sollte glücklich sein! Ich trainiere eine Software, die den Journalisten der Zukunft die Arbeit erleichtern soll. Die investigative Recherche am Leben erhält. Ich arbeite voll am Puls der Zeit – wer würde sich nicht wünschen, auch mal eine künstliche Intelligenz mit eigenem Hirnschmalz anzureichern?

Aber manchmal holen mich die Mühen der Ebene ein: Das Bürokratendeutsch der Politiker beispielsweise. Wird eine Maschine je verstehen können, was diese vor lauter Rhetorik wirklich meinen? Sie wiederholen die Argumente der Gegenseite, bevor sie verklausuliert zu ihren eigenen Standpunkten kommen, sie verwenden ohne Ende doppelte Verneinungen, Schachtelsätze – werden meine Annotationen dem Algorithmus wirklich helfen?

- Details

- Thema: Virtuelle Realität

Die ZEIT, 25. Feburar 2016

Die Virtuelle Realität fühlt sich realer an, als sich viele vorstellen können. Und sie kann missbraucht werden. Ein Ethik-Kodex soll der Gesellschaft helfen, die gute Verwendung der Technologie zu sichern.

Dieser Selbstmord war zu viel. Sean Buckley ist nicht allzu zart besaitet, er testet regelmäßig die neuesten Virtual-Reality-Killerspiele für das US-Magazin „engadget“. Aber als sich die junge Frau vor seinen Augen erschoss, zitterte er am ganzen Körper. „Das ist nicht fair, habe ich geschrien, ich bin völlig ausgeflippt“, beschreibt er seine Erfahrung im Nachhinein: „Sie war so real.“

Noch härter traf es die ersten Nutzer einer Demo für ein Sony-Headset. Dort konnte der Spieler die Pistole an die eigene Schläfe setzen und abdrücken. Der virtuelle Selbstmord versetzte die Betroffenen derart unter Stress, dass das Unternehmen das Feature schnell wieder entfernte. „Dieses Medium ist sehr mächtig, deshalb müssen wir vorsichtig mit dem sein, was wir anbieten“, kommentierte Sony-Chef Shuhei Yoshida den Vorfall. Der Virtual Reality wird für dieses Jahr der Durchbruch auf dem Massenmarkt vorhergesagt. Aber so manche Gamer machen derzeit Erfahrungen, die der Gesellschaft besser erspart bleiben sollten.

- Details

- Thema: Wissenschaftsreportage / Technik

Technology Review 02/16, Februar 2016

Politiker fordern Propagandamaterial von Terrororganisationen wie dem IS im Internet zu löschen. Sinnlos, sagt Zahed Amanullah vom Institute for Strategic Dialogue in London. Er setzt auf das Datenwissen von Google und Facebook, um dem Radikalismus Einhalt zu gebieten.

Herr Amanullah, Sie arbeiten mit Google, Facebook und Twitter zusammen, um Hasskommentare und Propaganda auf diesen Netzwerken einzudämmen. Dabei beeinflussen Sie die Inhalte, die Nutzer zu sehen bekommen. Wie haben Sie die Unternehmen dazu gebracht, mit Ihnen zusammen zu arbeiten?

Das war leicht. Wir haben ihnen in einer ersten Studie vor Augen geführt, wie sehr beispiesweise der IS ihre Netzwerke zur Propaganda benutzt, wie dort neue Terroristen rekrutiert werden. Sie waren sehr betroffen - und sehr offen für die Zusammenarbeit. Die Macher von Facebook und Co wollen schließlich, dass ihre Plattformen für Gutes genutzt werden.

Wenn diese Frage bei den Netzwerken Priorität hat, wieso kommen diese dann so schlecht dagegen an?

Die Anbieter haben lange versucht, entsprechende Profile und Posts zu löschen. Aber die Extremisten sind so gut vernetzt, dass das zu langsam ist. Die Inhalte gehen trotzdem raus und verbreiten sich schnell. Löschen funktioniert nicht.

- Details

- Thema: Portrait

Bild der Wissenschaft 01/2016

Einige ereignisreiche Tage im Leben des jungen Professors, der sich wie ein Detektiv auf die Spuren der Internetsucht begibt.

Ping! Christian Montag ist gerade im Büro angekommen, hat den Computer hochgefahren und die Bilder des jüngsten Hirnscans geöffnet, schon ertönt dieses vertraute „pling“, das eine Whatsapp-Nachricht auf seinem Smartphone ankündigt. „Dieses Ding“, sagt der 38-jährige Psychologe mit empörtem Unterton und fixiert sein Handy neben der Tastatur, „dieses Ding, das macht uns doch ganz kirre.“ Er angelt danach und stellt es auf lautlos. „Dieses Ding frequentiert unseren Alltag“, setzt er hinterher, „es unterbricht uns ständig beim Arbeiten. Wir können uns gar nicht mehr richtig konzentrieren.“ Er legt es weg und schaut ratlos vom BAP-Poster auf der einen Seite seines Büros zum Foto an der anderen Wand, das ihn selbst als Rockgittaristen zeigt . „Wo waren wir gerade?“

Und damit wären wir beim Thema. Christian Montag treibt die Frage um, wie sich Smartphone, Internet und Co auf unser Gehirn auswirken. Er ist kein Technologiekritiker. Aber als Psychologe weiß er, wie sehr ständige Unterbrechungen unser Arbeitsgedächtnis belasten. „Wir kommen heutzutage gar nicht mehr in einen konzentrierten Arbeitsflow“, sagt er. Denn dafür braucht man eine unterbrechungsfreie Zeit am Stück. Wer zu viele Baustellen gleichzeitig im Arbeitsalltag überblicken muss, der wird unkonzentriert und vergesslich. Und ist am Ende des Tages unzufrieden, weil er nicht recht voran kam. Das zermürbt viele.

- Details

- Thema: Wissenschaftsreportage / Technik

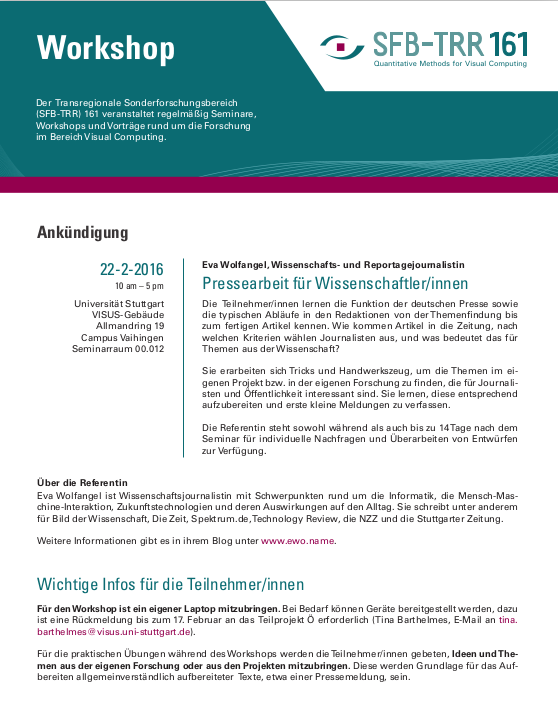

Am Montag, 22. Februar, startet mein erster Workshop "Pressearbeit für WissenschaftlerInnen" für den Sonderforschungsbereich "Quantitative Methods for Visual Computing" in Stuttgart. Ein zweiter Workshop findet am 4. April in Konstanz statt.

Inhalte sind unter anderem:

- Interaktiver Vortrag: Wie funktioniert die Presse? Nach welchen Kriterien werden News ausgewählt?

- Spiele, Übungen und Tricks, um das Thema in der eigenen Forschung zu finden

- Bad Practice: aus anderer Leute Fehler lernen

- Selbst besser machen: Am Ende hat jeder eine kleine Meldung geschrieben (es ist gar nicht so schwer!)

- Warum erfolgreiche Pressemitteilungen trotzdem manchmal ein Problem haben

Für die Teilnehmer gibt es hier die Folien (passwortgeschützt).