Datenjournalismus

Gemeinsam mit Computer-Linguisten der Uni Stuttgart habe ich den 'DebateExplorer' entwickelt: ein Tool, das via Textmining große Mengen an Bundestagsdebatten durchsucht und erkennt, über welche Themen die Abgeordneten diskutieren. Unsere Idee dabei: wenn uns künstliche Intelligenz dabei hilft zu erkennen, wann und wo ein Politiker beispielsweise seine Meinung zu einem bestimmten Thema geändert hat, wäre das ein guter Ansatz für eine journalistische Recherche - denn vielleicht wurde er ja von außen beeinflusst, vielleicht gar in unredlicher Weise.

Ich bin überzeugt, dass Künstliche Intelligenz den Journalismus voranbringen kann. Wir müssen allerdings davon wegkommen, Datenjournalismus vorallem als einen Weg zu "schönen Infografiken" zu sehen. Er kann mehr, und er kann vorallem Investigation unterstützen. Dazu habe ich einen vieldiskutierten Beitrag im "Meta-Magazin" geschrieben.

Zum Thema Daten und zur Frage, was Journalistinnen und Journalisten mit Künstlicher Intelligenz und Data-Mining machen können und sollten, biete ich Talks und Workshops an - beispielsweise auf der Weltkonferenz der WissenschaftsjournalistInnen 2019 in Lausanne.

Hier finden sich meine Blogartikel rund um unser Projekt DebateExplorer:

- Details

- Thema: Datenjournalismus

Blog über unser Datenjournalismus-Projekt DebateExplorer, November 2016

Auf der Wissenswerte, der Konferenz für Wissenschaftsjournalismus, präsentieren wir in einem Werkstattgespräch am Dienstag, 29.11., erste Ergebnisse unseres DebateExplorers: Können Maschinen Semantik verstehen, können sie sogar angesichts der verklausulierten Sprache der Politiker Muster in Bundestagsdebatten finden und uns Journalisten auf Auffälligkeiten stoßen, die wir ohne maschinelle Unterstützung nicht gefunden hätten? Unser Projekt auf der Basis der Förderung der Volkswagenstiftung im Projekt „Wissenschaft und Datenjournalismus“ erkundet seit Januar 2016 die Grenzen der Wissenschaft und versucht, sie zu verschieben. Wir wollen mit euch unsere Erfolge und die künftigen Herausforderungen diskutieren.

Unser Tool soll gerade in Zeiten knapper Mittel im Journalismus dafür sorgen, dass investigative Recherche nicht nur den großen Verlagen vorbehalten bleibt oder angesichts des Aufwands ganz ausstirbt. Wir nutzen öffentlich zugängliche Texte wie Bundestagsdebatten, Interviews und Artikel, um mittels automatischer Texterkennung aufzudecken, wie Debatten beeinflusst werden. Die Herausforderung dabei: die Algorithmen sollen nicht nur wortgleiche Passagen finden, sondern auch inhaltliche Gemeinsamkeiten, die verschieden formuliert sind. Dafür trainieren wir sie gemeinsam: JournalistInnen und ComputerlinguistInnen.

- Details

- Thema: Datenjournalismus

Blog über unser Datenjournalismusprojekt DebateExplorer, Oktober 2016

Unser Baby spricht die ersten eigenen Worte! Genau genommen findet es die ersten eigenen Worte, nämlich Debatten rund um die Hotelsteuer. Und unser kleiner Joe zeigt, dass er tatsächlich erstaunlich viel verstanden hat. Mehr, als ich mir in den mühsamen Zeiten der Annotationen hätte träumen lassen angesichts der komischen Sprache der Politiker.

„Wir hätten auch eine superintelligente Suchmaschine bauen können“, sagt Andre. Aber wir haben uns für die künstliche Intelligenz entschieden, auch wenn unklar war und sicher teilweise noch ist, ob eine Maschine so komplexe Annotationen erlernen kann, wie sie sich beispielsweise aus Bundestagsdebatten ergeben. Dafür haben wir so die Chance, Debatten vollständiger zu analysieren und auch jene Textstellen zu finden, die unerwartete Begriffe verwenden und gewohnte Begriffe auslassen. An diesen Grenzen der Forschung zu arbeiten ist aufregend und ein Risiko, weil man nie weiß, ob es am Ende funktioniert. Aber heute haben wir einen Teilerfolg errungen.

- Details

- Thema: Datenjournalismus

Blog über unser Datenjournalismus-Projekt Debate Explorer, August 2016

So gruselig der aktuelle Stuttgart-Tatort ist, in dem eine Künstliche Intelligenz unkontrollierbar wird, so sehr wünsche ich mir, wir hätten eine Maschine, die uns ein bisschen besser versteht! Wer mit Sprachdaten arbeitet und hofft, dass uns Journalisten die Automatisierung ein wenig Arbeit abnimmt, staunt nur ob der Ankündigung der ARD: „Der Tatort HAL spielt in der nahen Zukunft, die vielleicht schneller Gegenwart ist, als wir erwarten.“ Hach, wir arbeiten an dieser nahen Zukunft, die mir gerade doch wieder etwas weiter weg erscheint.

Zu gerne würde ich unserer Maschine zurufen: Versteh mich doch, es geht um Vorratsdatenspeicherung! Aber die Wortwolke in unserer Topicsuche, die mir helfen soll, ein Thema möglichst vollständig zu finden, ist ziemlich breit geworden: in ihrem Zentrum stehen nach wie vor Begriffe wie Datenschutz und Internet. Aber seit wir unsere Daten um Spiegel-Online-Artikel erweitert haben, bekomme ich eine breite Masse an Vorschlägen, die irgendwie auch in diesen Thementopf gehören aber mit Vorratsdatenspeicherung zu tun haben.

- Details

- Thema: Datenjournalismus

Blog über unser Datenjournalismusprojekt DebateExlorer, Mai 2016

Und schwupp! Schon ist es noch schwieriger, die passenden Beiträge zu finden. Ich widme mich nach der Hotelsteuer dem Thema Vorratsdatenspeicherung, während Computerlinguist Andre Blessing versucht, unser System mit meinen Annotationen zu trainieren und ihm erste eigene Vorschläge zur Hotelsteuer zu entlocken. Bei der Vorratsdatenspeicherung fällt mir auf, dass Hotelsteuer noch ein einfaches Thema war. Es gab ein ganz klares pro und contra: die Redner im Bundestag waren entweder dafür, dass Hotels und Gaststätten einen ermäßigten Mehrwertsteuersatz bekommen, oder sie waren dagegen. Und schon da fiel es mir immer wieder schwer, unserer „Maschine“ zu sagen, wer nun gerade dafür oder dagegen argumentiert – unter anderem wegen der perfiden Rhetorik im Bundestag. Aber da sind nun die Computerlinguisten an der Reihe um zu sehen, ob meine Annotationen dazu geführt haben, dass das System etwas gelernt hat.

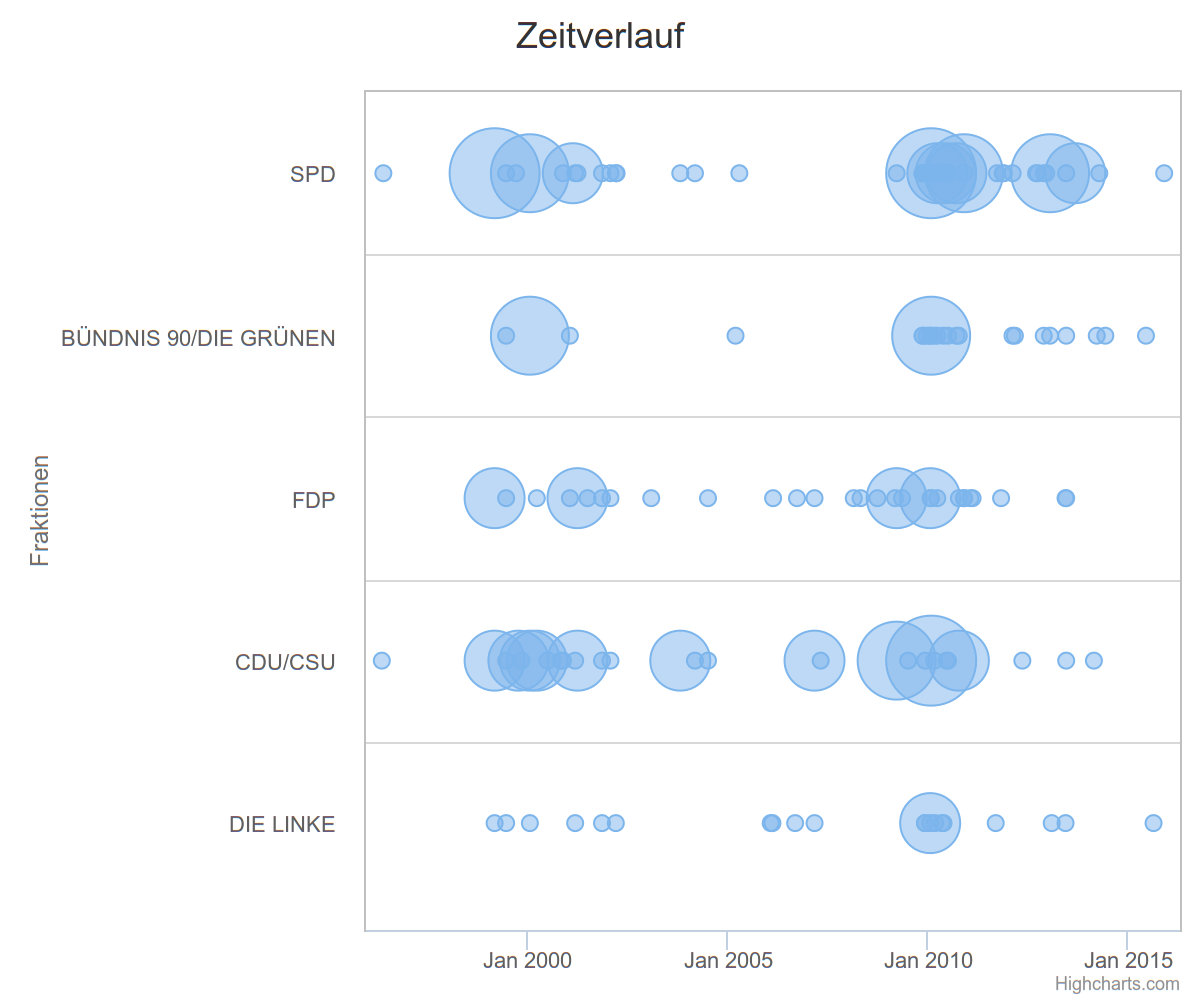

Erste Ergebnisse, die das System auf der Suche nach Mustern in der gesamten Datenmassen gefunden hat – unabhängig von meiner Annotation, also durch unüberwachtes Lernen – lassen mich hoffen:

- Details

- Thema: Datenjournalismus