Meine Themengebiete

- Details

- Thema: Datenjournalismus

Blog über unser Datenjournalismus-Projekt DebateExplorer, November 2016

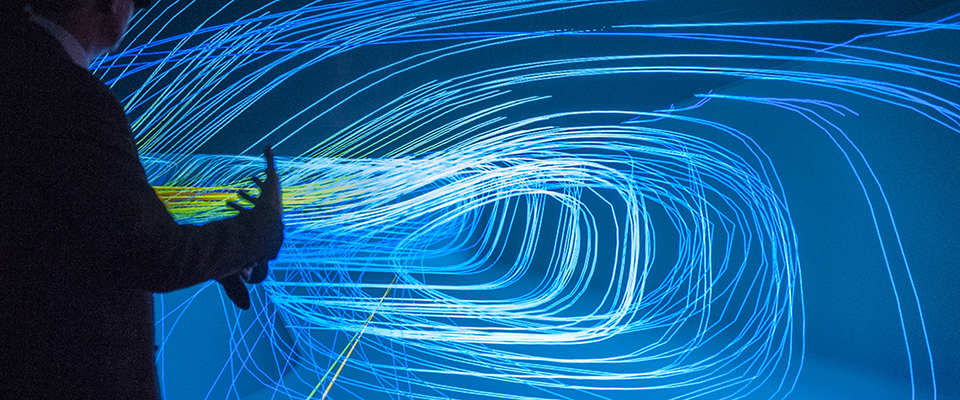

Auf der Wissenswerte, der Konferenz für Wissenschaftsjournalismus, präsentieren wir in einem Werkstattgespräch am Dienstag, 29.11., erste Ergebnisse unseres DebateExplorers: Können Maschinen Semantik verstehen, können sie sogar angesichts der verklausulierten Sprache der Politiker Muster in Bundestagsdebatten finden und uns Journalisten auf Auffälligkeiten stoßen, die wir ohne maschinelle Unterstützung nicht gefunden hätten? Unser Projekt auf der Basis der Förderung der Volkswagenstiftung im Projekt „Wissenschaft und Datenjournalismus“ erkundet seit Januar 2016 die Grenzen der Wissenschaft und versucht, sie zu verschieben. Wir wollen mit euch unsere Erfolge und die künftigen Herausforderungen diskutieren.

Unser Tool soll gerade in Zeiten knapper Mittel im Journalismus dafür sorgen, dass investigative Recherche nicht nur den großen Verlagen vorbehalten bleibt oder angesichts des Aufwands ganz ausstirbt. Wir nutzen öffentlich zugängliche Texte wie Bundestagsdebatten, Interviews und Artikel, um mittels automatischer Texterkennung aufzudecken, wie Debatten beeinflusst werden. Die Herausforderung dabei: die Algorithmen sollen nicht nur wortgleiche Passagen finden, sondern auch inhaltliche Gemeinsamkeiten, die verschieden formuliert sind. Dafür trainieren wir sie gemeinsam: JournalistInnen und ComputerlinguistInnen.

- Details

- Thema: Wissenschaftsreportage / Technik

Süddeutsche Zeitung Wochenende, 29. Oktober 2016 - Link

Menschliches Handeln ist in weiten Teilen vorhersagbar. Roboter nutzen das erfolgreich, um soziales Verhalten zu imitieren. Aber wie echt ist diese berechnete Hilfsbereitschaft?

Der kleine Kerl bewegt seine Arme und folgt diesen Bewegungen mit großen Augen, als nehme er diese Arme zum ersten Mal wahr. Noch scheint der Weg weit zu sozialem Verhalten: Erst einmal geht es darum, den eigenen Körper zu erfassen und dessen Grenzen, um überhaupt verstehen zu können, dass es ein „Ich“ und ein „Du“ gibt. Bei jeder Bewegung des Arms scheint sich der Kleine zu fragen: „Bin das ich? Mache ich das?“ Er bewegt seine Gliedmaßen unermüdlich und scheinbar zufällig, er testet, welche Richtungen seine Gelenke zulassen. Er dreht den Kopf so weit er kann und schaut sich um. Mit der Zeit werden die Bewegungen gezielter. Er hat gelernt, wie weit sein Radius ist, welche Positionen er erreichen kann. Später, als er verstanden hat, wo der eigene Körper aufhört, kommt ein Mann und reicht ihm einen Ball. Der kleine Kerl will ihn haben, greift aber erst unbeholfen daneben. Aber auch darin wird er mit etwas Übung immer besser: die erste Interaktion funktioniert!

- Details

- Thema: Wissenschaftsreportage / Technik

Magazin Reportagen Nr. 30, September 2016 - nominiert für den Reporterpreis!

Meine Reportage über unser virtuelles Leben der Zukunft, die weltweit erste Reportage aus der virtuellen Realität, ist für den Deutschen Reporterpreis in der Kategorie "Beste Reportage" nominiert. Aus diesem Anlass hier schon der gesamte Text über meine Leben dort in dieser Parallelwelt, die sich fast so echt anfühlt wie die andere, die echte Welt. Mit allen positiven und negativen Begleiterscheinungen.

Noch wirkt alles ganz harmlos. Ein Sonnenstrahl landet direkt vor meinen Füßen, er hat eine weite Reise hinter sich, auch wenn es ihn eigentlich gar nicht gibt. Der Sonnenstrahl hat sich seinen Weg durch dicke Wolken vor dem Fenster gebahnt, er ist gereist auf winzigen Regentropfen von weit oben aus dem Himmel bis hier zu mir auf den Parkettboden. Warm und weich kitzelt er jetzt meinen Fuß. Ich schaue mich um: der Raum ist würfelförmig, an drei Seiten begrenzt durch riesige Glasfronten. Die vierte Wand ist fast in der gesamten Breite ausgefüllt von einem riesigen Display, auf dem ein Film läuft. Einige Männer stehen davor und lachen.

- Details

- Thema: Virtuelle Realität

Magazin Reportagen Nr. 30, September 2016 - nominiert für den Reporterpreis!

Meine Reportage über unser virtuelles Leben der Zukunft, die weltweit erste Reportage aus der virtuellen Realität, ist für den Deutschen Reporterpreis in der Kategorie "Beste Reportage" nominiert. Aus diesem Anlass hier schon der gesamte Text über meine Leben dort in dieser Parallelwelt, die sich fast so echt anfühlt wie die andere, die echte Welt. Mit allen positiven und negativen Begleiterscheinungen.

Noch wirkt alles ganz harmlos. Ein Sonnenstrahl landet direkt vor meinen Füßen, er hat eine weite Reise hinter sich, auch wenn es ihn eigentlich gar nicht gibt. Der Sonnenstrahl hat sich seinen Weg durch dicke Wolken vor dem Fenster gebahnt, er ist gereist auf winzigen Regentropfen von weit oben aus dem Himmel bis hier zu mir auf den Parkettboden. Warm und weich kitzelt er jetzt meinen Fuß. Ich schaue mich um: der Raum ist würfelförmig, an drei Seiten begrenzt durch riesige Glasfronten. Die vierte Wand ist fast in der gesamten Breite ausgefüllt von einem riesigen Display, auf dem ein Film läuft. Einige Männer stehen davor und lachen.

- Details

- Thema: Wissenschaftsreportage / Technik

Technology Review, September 2016

Schick, unauffällig, cool, exakt und kompatibel: das perfekte Wearable müsste eine eierlegende Wollmilchsau sein. Um die kleinen tragbaren Computer steht es weniger rosig, als es auf den ersten Blick erscheint.

Ausgerechnet Wearable-Pionier Thad Starner hat sich verrechnet. Smartphones würden sich bald überholt haben, sagte er vor einigen Jahren im Brustton der Überzeugung, als er die Googlebrille mit entwickelte. „Sie sind für mich persönlich ein Rückschritt.“ Die Zukunft seien Wearables, Kopfdisplays beispielweise wie die Googleglass oder sein selbstentwickeltes System, das er seit mehr als 20 Jahren nutzt: eine globige Brille, verbunden mit einem über die Jahre immer kleiner werdenden Computer, den er irgendwo am Körper trägt. Aber irgendwas ging schief an diesem Plan: die Googlebrille floppte im Konsumentenbereich, das Smartphone erfreut sich bis heute großer Beliebtheit.

Wer den Zahlen der großen Beratungsgesellschaften folgt, könnte tatsächlich zur Meinung gelangen, dass das Smartphone bald durch Wearables aller Art abgelöst wird. Aber die Zahlen sind bei genauem Hinsehen trügerisch: Die Beratungsgesellschaft Pricewaterhouse Coopers pwc diagnostiziert gar ein Wachstum im Bereich der Smartwatches auf dem deutschen Markt von 614 Prozent von 2013 auf 2014. Kunststück – Smartwatches waren 2013 noch quasi unbedeutend für Konsumenten: Samsungs Galaxy Gear kam im September 2013 auf den Markt und gilt als eine der ersten Uhren, für die sich auch Kreise jenseits von Geeks interessierten – und schon im November musste Samsung zugeben, bei den Zahlen geschummelt zu haben: statt der verkauften wurden verschiffte Geräte angegeben. 2015 gaben 17 Prozent der Befragten einer PwC-Online-Umfrage an, bereits ein Wearable zu besitzen. Wenn man bedenkt, dass jedes Fitnessarmband als Wearable zählt und manche Krankenkassen diese gar verschenken, erscheint diese Zahl erstaunlich klein. „Bei den meisten landen diese sowieso nach ein paar Monaten in der Schublade“, sagt Gerhard Tröster, Leiter des Elektronik-Labors der ETH Zürich. Das große Versprechen der Wearables scheint ausgerechnet beim meistverkauften Produkt ihrer Klasse nicht aufzugehen: die kleinen Computer fügen sich nicht so unauffällig in den Alltag ein, dass wir sie ständig dabei haben. Sie fügen sich noch unaufälliger in die Schubalde ein.