Meine Themengebiete

- Details

- Thema: Portrait

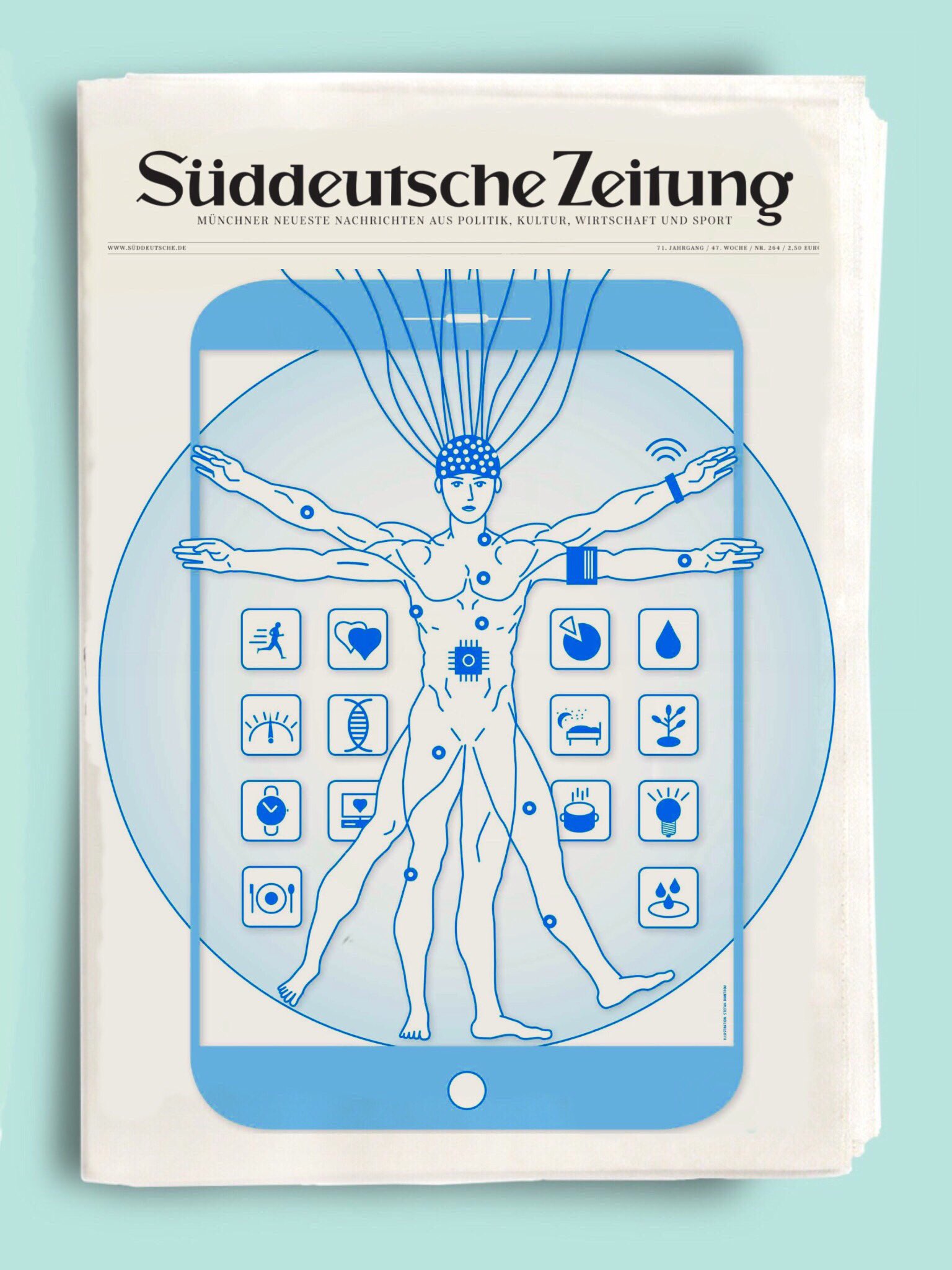

Süddeutsche Zeitung am Wochenende, 26. August 2017

Florian Schumacher optimiert sein Leben, indem er alles misst, was sich messen lässt. Manchmal hinterlässt das Rätsel.

Der Regen spielt am frühen Morgen mit feinen Fingern Cembalo auf den Blättern der Bäume, ein paar Menschen radeln missmutig durch den Englischen Garten, das grelle Grün der Blätter schmerzt in den schlaftrunkenen Augen, und Florian Schumacher atmet tief durch. 15 Regentropfen, Schritt, Schritt, einatmen, Schritt, Schritt, ausatmen 15 – 2 –1- 2 - 2 1, er fühlt, wie der Rhythmus Leben in die müden Glieder bringt und wie der steigende Puls den Körper sanft weckt 80, 90, 100, 120, 130, der Läufer schaut auf die Uhr, nickt, lächelt, trabt.

- Details

- Thema: Wissenschaftsreportage / Technik

Süddeutsche Zeitung am Wochenende, 29. Juli 2017 In Bildern stecken mehr Informationen, als sich die meisten Menschen vorstellen können. Angesichts der wachsenden Zahl an Kameras tüfteln Forscher an Konzepten, um den Schutz der Privatsphäre in der Technik zu verankern. Doch auch das hat seine Tücken.

Die Künstliche Intelligenz stellt fest: Im Restaurant Zunfthaus zur Waag im historischen Zentrum Zürichs sitzen 35 Gäste, weitere 24 genießen die Sonne unter den Sonnenschirmen, darunter eine ungewöhnlich große Gruppe. Im Haus sind aktuell acht Bewohner, der erste hat es heute um 6.45 Uhr verlassen, normalerweise kehren die letzten gegen 23 Uhr zurück. Die Fassade ist relativ frisch gestrichen, doch es zeigen sich erste kleine Schäden unterhalb eines Fensters im dritten Stock. Durch die oberen Fenster fällt am meisten Licht, zwei davon sind geöffnet, in den mittleren spiegelt sich das Haus gegenüber. Es finden sich kaum freie Parkplätze in der Nähe, und am benachbarten Paradeplatz sammeln sich auffällig viele Menschen. Vielleicht sollte man dort eine Polizeistreife vorbeischicken, nur sicherheitshalber, und vielleicht sollte man der Mutter des Kindes, das sein Zimmer im vierten Stock zur Sonnenseite hat, zu einer Verdunkelung raten, denn das System hat berechnet, dass der Raum um diese Zeit stark aufheizt, da das Fenster mit seiner Größe von 2,2 mal 1,5 Meter und dieser Ausrichtung viel Sonne hereinlässt.

- Details

- Thema: Wissenschaftsreportage / Technik

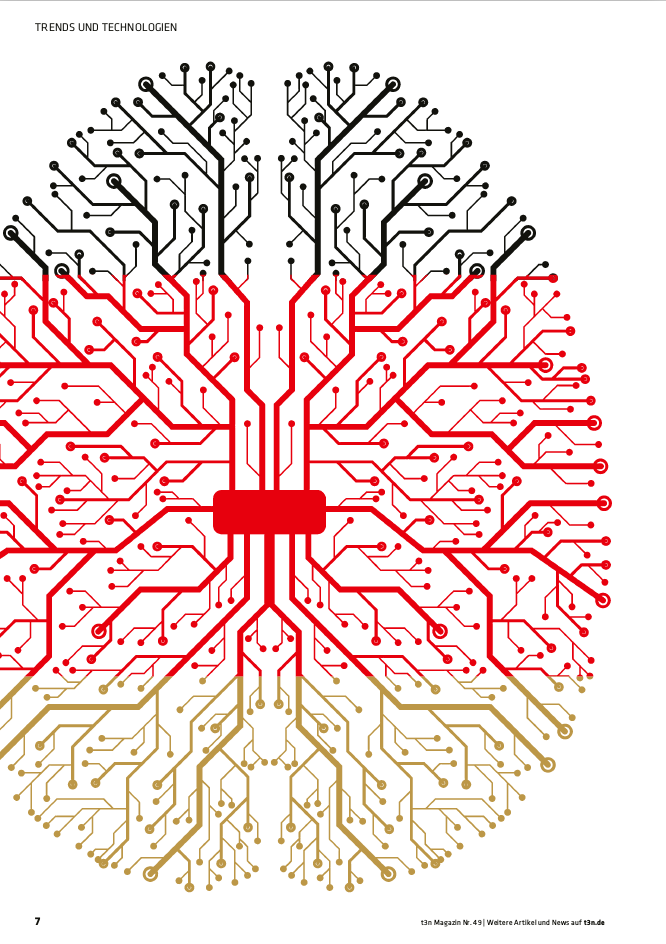

Magazin t3n Nr 48, Drittes Quartal 2017

Verschlafen die deutschen Unternehmen die Chancen der künstlichen Intelligenz? Laut aktueller Studien sind sie kaum vorbereitet. Das zeigen auch Einblicke in die Praxis. Startups sind da deutlich weiter – und übertreffen selbst die großen KI-Pioniere.

Bist du schwul, depressiv oder in Kauflaune? Sorgst du dich um deine Kinder, bist du ein aggressiver Zeitgenosse oder hast du gar eine Ehekrise? Das alles – so heißt es - weiß die künstliche Intelligenz über uns: Sie kennt uns besser als unsere Freunde uns kennen, weiß mehr, als unser Partner über uns. Das zumindest behaupten jene, die von solchen Entwicklungen profitieren: Immer mal wieder geistern Studien durch die Medien, die beispielsweise aus Twitterdaten vorhersagen, ob jemand eine psychische Krankheit entwickelt oder aus Facebook-Posts die Persönlichkeit berechnen, für deren Definition Psychologen fünf Fragebögen und sechs Monate persönliche Gespräche benötigen.

- Details

- Thema: Wissenschaftsreportage / Technik

Künstliche Intelligenz interpretiert die Welt auf ihre eigene Weise – und zementiert damit Vorurteile, Rassismus und Rollenklischees. Das führt die Suche nach der Formel für Gerechtigkeit ad absurdum.

Dieser Emmanuel Macron! Dankt am Abend seines Wahlsieges seinen "amerikanischen Mitbürgern" für ihr Vertrauen! Wer Macrons Tweet vom 7. Mai las, der musste sich wundern – jedenfalls hierzulande und in Amerika. In der automatischen Übersetzung, die Twitter deutschen Nutzern anbot, war von "tiefer Dankbarkeit" gegenüber den "amerikanischen Mitbürgern" die Rede. Auch in den USA wurde Macrons Anrede "mes chers compatriotes" als "my fellow americans" übersetzt. Dabei bedeutet compatriotes im Französischen schlicht "Mitbürger". Über Amerikaner hatte Macron kein Wort verloren. Wie Twitter nur darauf kam?- Details

- Thema: Wissenschaftsreportage / Technik

Die ZEIT, 1. Juni 2017 - Ausschnitt

Wenn jemand per Internet eine Überweisung tätigt, hinterlässt er einzigartige Spuren. Anhand solcher biometrischer Merkmale identifiziert eine diskrete Firma im Auftrag von Banken Millionen von Nutzern. Die ahnen davon nichts.

Seelenruhig schaut Natia Golan zu, wie der Hacker seinen Raub vorbereitet. Er hat die Kontrolle über das Online-Konto einer ahnungslosen britischen Bankkundin übernommen, als sie gerade Geld überwies. Kaum war sie fertig, griff er aus der Ferne zu. Er tippt ihr Passwort in die Maske und gibt vor, vor dem Computer der Kundin in Großbritannien zu sitzen. Das Passwort stimmt. Auch die Summe von etwas mehr als einer Million Pfund, die er gerade überweisen will, ist nicht unüblich für die überdurchschnittlich wohlhabenden Kunden. Und doch: Ein Detail stört das Bild.